2025年3月29日22时44分,一辆小米SU7标准版在德上高速公路池祁段行驶过程中遭遇严重交通事故。根据小米公司披露的信息,事故发生前车辆处于NOA智能辅助驾驶状态,以116km/h时速持续行驶。事发路段因施工修缮,用路障封闭自车道、改道至逆向车道。车辆检测出障碍物后发出提醒并开始减速。随后驾驶员接管车辆进入人驾状态,持续减速并操控车辆转向,随后车辆与隔离带水泥桩发生碰撞,碰撞前系统最后可以确认的时速约为97km/h。

小米汽车本身具有不小的话题性,事故出现后引起很多用户的争论,但很多人要么站队小米,指责驾驶员和其他批判小米的人,认为这起事故完全和小米无关,要么批判小米的技术,认为小米的技术不够好,不能保证安全。

这种口水仗毫无意义,不如跳出这些话题,谈谈人因工程。

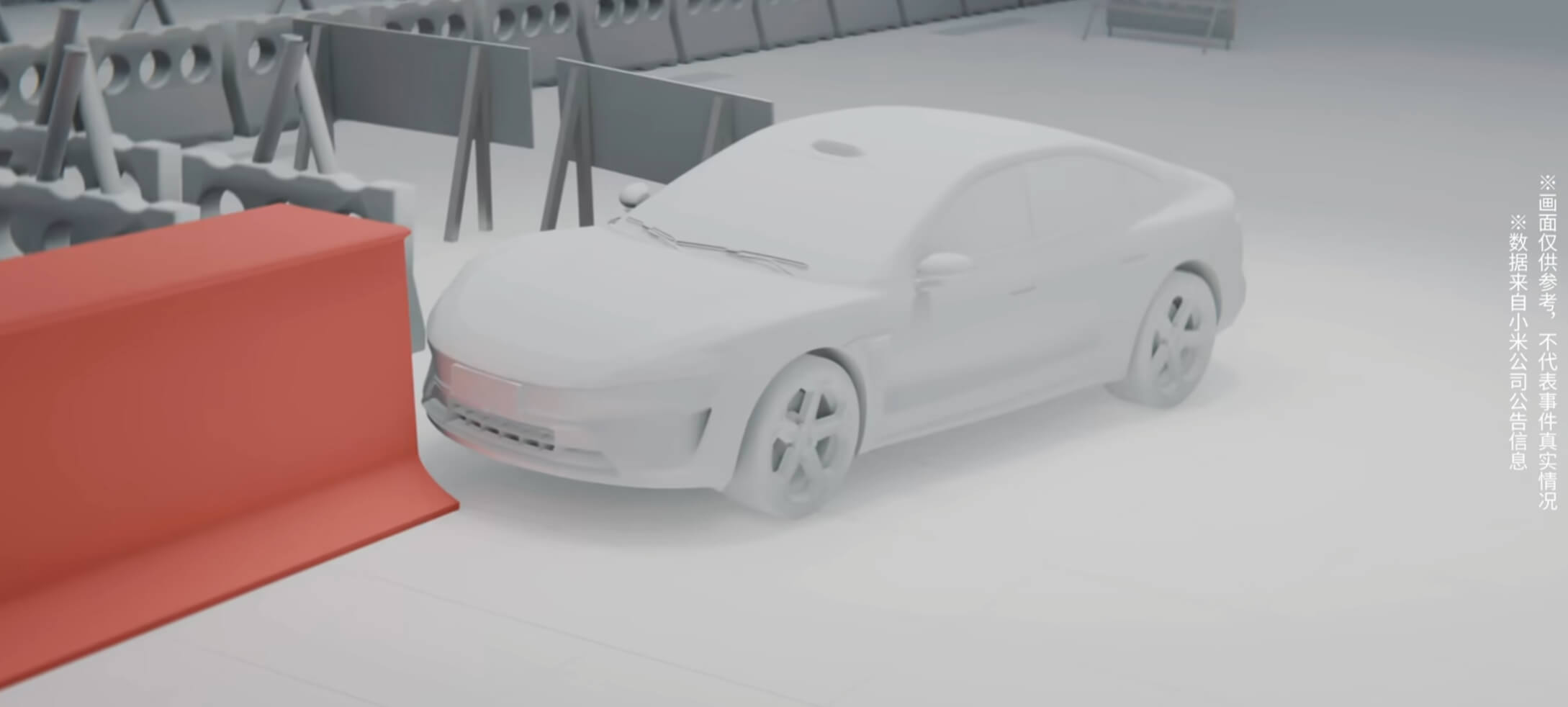

首先尝试还原一下事故核心场景:

随着筒锥的逼近,自动驾驶终于识别到前方有障碍物,告警提示驾驶员接管,但距离已经太近,驾驶员情急之下手打方向盘22度然后回正,最后与侧面护栏相撞。

整个轨迹大概如图:

如上图,事故其实是驾驶员为了避障过度转向导致的事故。

但这并非驾驶员的错误。

根据小米披露的数据,事发前驾驶员转向22度,刹车踏板开合角度31度。

在高速路上,方向盘打22度是什么概念?一般正常变道或轻微转向通常只需要约5-15度的方向盘转动角度。紧急避险情况下,方向盘转动角度可能会达到20-30度,但这已经是相当大的转向幅度,会导致车辆明显的横向移动。高速行驶时(如100km/h以上)方向盘转动超过30度就已经是非常剧烈的转向了,可能导致车辆失控。

也就是说,这个转动幅度很大,但并非完全不能操作。那看起来好像还是驾驶员的经验与能力的问题?

然而,将责任归咎于驾驶员是不公平的。这涉及到人因工程中的一个核心概念:情景意识(Situation Awareness)。在这种紧急情况下,我们不能期望驾驶员能够立即建立完整的情景意识。

传统手动驾驶中,驾驶员需要不断进行微调方向盘,这个过程帮助大脑建立了速度与转向角度之间的对应关系。这种持续的反馈形成了驾驶员的情景意识,使他们能够准确判断在特定速度下需要多大的转向角度。

智能辅助驾驶系统虽然减轻了驾驶员的负担,但同时也切断了这种持续反馈。当系统突然要求驾驶员接管时,驾驶员缺乏当前情境下的”感觉”,只能依靠长期记忆中的经验来判断。

在非紧急情况下,驾驶员通常会先尝试小角度转向,然后根据车辆反应逐渐调整。但当障碍物近在眼前时,驾驶员必须立即给出一个”足够大”的转向角度,而这个判断往往不够准确。本次事故中,驾驶员给出的22度转向角度就是这种紧急情况下的本能反应。

这种现象在航空领域有着更为惨痛的教训。2009年的法航447航班空难就是一个典型案例:当空速管结冰导致自动驾驶突然退出时,接手的飞行员缺乏对当前飞行状态的准确感知,做出了错误的操作决策,最终导致飞机坠毁,228人全部遇难。

这类事故之所以反复发生,是因为现代自动化系统往往将人排除在控制回路之外。系统正常运行时,操作员不需要(也不被要求)了解系统的所有细节。随着时间推移,操作员对系统状态的理解逐渐过时,当系统突然要求人工接管时,操作员需要时间重新建立情景意识,而紧急情况往往不给这个时间。

人因工程学界将这种现象称为”伐木工效应”(Lumberjack Effect):自动化程度越高,操作员在日常中的参与度就越低,技能保持越差,当需要接管时就越容易出错。这是一个悖论:自动化系统越先进,在罕见的需要人工接管的情况下,失败的风险反而更高。

解决这一问题的方向包括:设计更透明的自动化系统,让操作员始终了解系统状态;开发自适应自动化,根据情况动态调整自动化水平;将自动化系统设计为”团队成员”而非替代者,保持人在回路中的参与。

让我想起了《流浪地球2》里最后的彩蛋,提到moss的训练模式引入了 人在回路 。

遗憾的是,工业界特别是国内对人因工程的重视程度不够。人因工程常被视为”软科学”,甚至被贬低为”文科”。当系统设计要求人类做出超出人类能力范围的操作时,事故责任往往被归咎于操作员”不够专注”或”训练不足”。

只有航空、核电等对安全有极高要求的行业才真正重视人因工程。对于新兴的智能驾驶领域,这方面的进步可能还需要付出更多代价才能实现。